Penilaian Risiko Sistematis untuk Keterbatasan Jaringan Neural dalam Persepsi Kendaraan Otonom

Pelajari tentang penilaian risiko sistematis untuk keterbatasan Jaringan Neural dalam persepsi kendaraan otonom, mengintegrasikan HARA dan TARA untuk keselamatan dan keamanan AI.

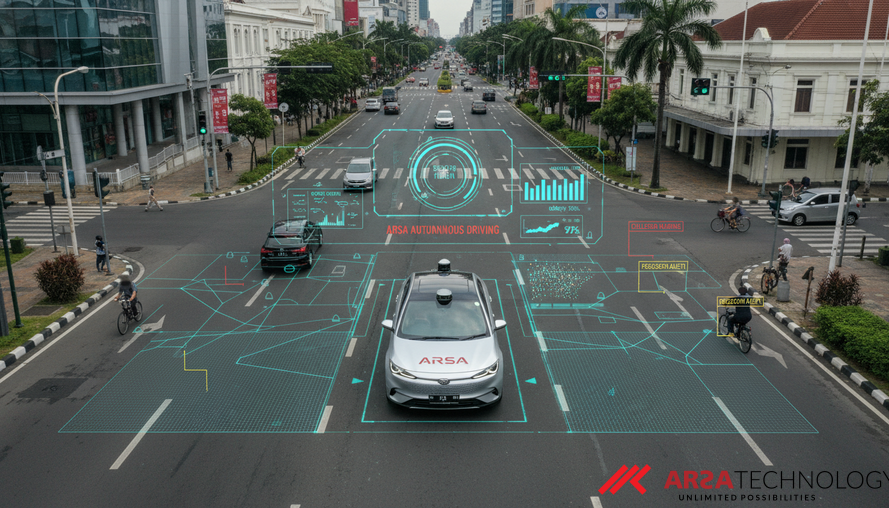

Kendaraan otonom (Autonomous Driving/AD) menjanjikan revolusi dalam transportasi, menawarkan efisiensi dan potensi keselamatan yang belum pernah ada sebelumnya. Namun, untuk mewujudkan visi ini, kepercayaan dan penerimaan publik menjadi sangat penting, dan hal ini hanya dapat dicapai melalui jaminan keselamatan dan keamanan yang tak tergoyahkan. Di jantung sistem AD modern adalah Deep Neural Network (DNN), yang bertindak sebagai "mata" dan "otak" untuk persepsi lingkungan sekitar kendaraan. Meskipun kekuatan DNN tidak dapat disangkal, mereka datang dengan serangkaian keterbatasan inheren yang, jika tidak ditangani secara sistematis, dapat menimbulkan risiko signifikan terhadap perilaku kendaraan dan keselamatan penumpang.

Penelitian akademis, seperti yang disajikan dalam paper "Towards a Systematic Risk Assessment of Deep Neural Network Limitations in Autonomous Driving Perception" oleh Pavlitska et al. (2026) dari FZI Research Center for Information Technology dan Karlsruhe Institute of Technology (Sumber: https://arxiv.org/abs/2604.20895), menyoroti kebutuhan mendesak untuk secara komprehensif mengevaluasi risiko-risiko ini. Paper ini mengusulkan alur kerja gabungan untuk penilaian risiko, menggabungkan Analisis Bahaya dan Penilaian Risiko (HARA) sesuai ISO 26262 dan Analisis Ancaman dan Penilaian Risiko (TARA) sesuai ISO/SAE 21434, yang disesuaikan secara khusus untuk keterbatasan DNN dalam persepsi AD.

Memahami Keterbatasan Fundamental DNN dalam Kendaraan Otonom

Jaringan neural mendalam, meskipun sangat kuat, memiliki keterbatasan bawaan yang dapat dibagi menjadi dua kategori besar: yang berasal dari "sifat" arsitektur intrinsiknya (misalnya, batas keputusan linier atau kurangnya penalaran kausal) dan yang berasal dari "pemeliharaan" (misalnya, data bias atau pelatihan yang tidak memadai). Sementara masalah yang berhubungan dengan "pemeliharaan" sering kali dapat diatasi dengan data atau pelatihan yang lebih baik, keterbatasan berdasarkan "sifat" secara struktural inheren dan lebih sulit dipecahkan.

Definisi yang digunakan dalam konteks ini adalah "ketidakcukupan DNN adalah properti dari model DNN terlatih yang memiliki dampak negatif untuk penggunaan dalam sistem yang relevan dengan keselamatan, dan merupakan inheren dari teknologi DNN. Ketidakcukupan DNN yang terukur menyebabkan kesalahan yang menurunkan ukuran kinerja terkait." Untuk kendaraan otonom tingkat SAE 3-4, di mana DNN memainkan peran yang semakin besar, dampak kesalahan semacam itu sangatlah krusial. Lima keterbatasan utama DNN yang berdampak langsung pada keselamatan dan keamanan dalam persepsi kendaraan otonom meliputi:

- Kurangnya Generalisasi: DNN sering gagal untuk menggeneralisasi di luar data pelatihan. Ini berarti mereka kesulitan untuk bekerja dengan andal pada data yang berbeda dari distribusi pelatihan, seperti dalam skenario berkendara yang jarang, baru, atau kondisi adversarial. Dalam AD, skenario ekor panjang (long-tail driving scenarios), kasus-kasus ekstrem (corner cases), dan peristiwa yang belum pernah terlihat sebelumnya menimbulkan masalah signifikan. Ini menimbulkan pertanyaan tentang bagaimana sistem akan bereaksi terhadap kondisi cuaca ekstrem, pola lalu lintas yang tidak biasa, atau rintangan tak terduga.

Kurangnya Efisiensi: Karena arsitektur yang dalam dan banyaknya parameter, DNN membutuhkan sumber daya perangkat keras yang signifikan. Ini membuat penerapan di lingkungan yang terbatas sumber daya seperti kendaraan otonom menjadi menantang. Optimalisasi seperti pruning* (memangkas model) biasanya mengorbankan akurasi atau ketahanan. Penggunaan sistem AI yang optimal di tepi jaringan (edge AI) seperti yang diterapkan pada ARSA AI Box Series dapat membantu mengatasi tantangan efisiensi ini dengan memproses data secara lokal.

- Kurangnya Penjelasan (Explainability): DNN memiliki representasi internal dan proses pengambilan keputusan yang kompleks dan tidak transparan, yang membatasi kemampuan pengembang dan pengguna untuk memahami, mempercayai, dan memverifikasi output-nya. Dalam sistem keselamatan kritis, mampu menjelaskan "mengapa" suatu keputusan dibuat sangat penting untuk akuntabilitas dan diagnostik.

- Kurangnya Kelayakan (Plausibility): DNN dapat memberikan kepercayaan tinggi pada output yang melanggar hukum fisika atau batasan akal sehat. Contoh untuk AD adalah pejalan kaki atau mobil yang melayang di udara atau memiliki bentuk yang tidak realistis. Ketidaklayakan ini dapat mengarah pada keputusan yang berbahaya jika sistem tidak dapat mengenali dan mengoreksi output yang tidak masuk akal.

Kurangnya Ketahanan (Robustness): DNN menunjukkan kinerja yang berkurang untuk gangguan input dan, khususnya, rentan terhadap serangan adversarial yang sengaja dibuat. Serangan ini dapat berupa adversarial patch* (tambalan adversarial) yang terlihat tidak berbahaya bagi mata manusia tetapi dapat menyebabkan DNN salah mengklasifikasikan objek penting, menimbulkan risiko keamanan dan keselamatan yang serius.

Kesenjangan dalam Kerangka Penilaian Risiko yang Ada

Kerangka penilaian risiko yang ada untuk kendaraan otonom, seperti HARA (Hazard Analysis and Risk Assessment) dalam ISO 26262 untuk keselamatan fungsional dan TARA (Threat Analysis and Risk Assessment) dalam ISO/SAE 21434 untuk keamanan siber otomotif, sangat penting. Namun, standar-standar ini, dan juga standar yang lebih baru yang membahas malfungsi AI secara umum seperti ISO PAS 8800, cenderung membahas semua kemungkinan malfungsi dalam kendaraan otonom tanpa fokus khusus pada yang berakar pada keterbatasan DNN.

Selain itu, standar yang lebih lama sebagian besar berfokus pada kendaraan jalan raya dengan tingkat otomatisasi berkendara SAE Level 1-2. DNN, bagaimanapun, memainkan peran yang jauh lebih besar dalam kendaraan otonom Level 3-4, di mana kontrol diambil alih oleh AI dalam skenario yang lebih kompleks. Oleh karena itu, kesalahan yang berakar pada DNN dapat memiliki dampak yang lebih besar pada keselamatan kendaraan ini. Ada kesenjangan penelitian dalam mengatasi risiko yang secara khusus berasal dari keterbatasan DNN. Risiko yang muncul dari beberapa keterbatasan, seperti kurangnya ketahanan dan penjelasan, telah lebih sering dipertimbangkan, sementara yang lain, seperti kurangnya kelayakan, kurang mendapat perhatian dalam analisis risiko sistematis.

Pendekatan HARA-TARA Terpadu untuk Risiko DNN

Untuk mengatasi kesenjangan ini, paper oleh Pavlitska et al. mengusulkan alur kerja gabungan HARA-TARA yang disesuaikan secara khusus untuk persepsi berbasis DNN. Pendekatan ini mengakui bahwa keterbatasan DNN dapat menyebabkan risiko keselamatan (misalnya, kendaraan gagal mengenali rintangan karena kurangnya generalisasi) dan risiko keamanan (misalnya, serangan adversarial menyebabkan sistem salah mengklasifikasikan tanda berhenti).

Dengan mengintegrasikan HARA dan TARA, para peneliti dapat secara sistematis mengidentifikasi bahaya dan ancaman yang timbul dari keterbatasan DNN, menganalisis potensi dampak, dan menilai tingkat risiko. Pendekatan ini memungkinkan analisis holistik yang mempertimbangkan interdependensi antara keselamatan dan keamanan, yang sering kali terabaikan ketika analisis dilakukan secara terpisah. Contohnya, sistem persepsi AI ARSA AI Video Analytics dirancang untuk mendeteksi anomali secara real-time dan dapat disesuaikan untuk mengidentifikasi skenario yang tidak biasa, mengurangi bahaya operasional.

Implikasi Praktis dan Penerapan di Dunia Nyata

Penerapan pendekatan penilaian risiko yang sistematis untuk keterbatasan DNN memiliki implikasi praktis yang luas bagi industri kendaraan otonom:

- Peningkatan Keselamatan: Dengan secara proaktif mengidentifikasi dan memitigasi risiko yang berasal dari keterbatasan DNN, produsen dapat merancang sistem yang lebih aman, mengurangi kemungkinan kecelakaan yang disebabkan oleh kesalahan persepsi AI. Ini sangat penting untuk sistem canggih seperti Smart Parking System yang mengandalkan persepsi akurat untuk operasi yang aman.

- Peningkatan Keamanan Siber: Analisis ancaman yang terintegrasi membantu melindungi sistem AD dari serangan siber yang menargetkan kerentanan DNN, memastikan bahwa kendaraan tidak dapat dimanipulasi untuk membuat keputusan berbahaya.

- Kepercayaan dan Penerimaan Publik: Demonstrasi yang jelas mengenai upaya sistematis untuk mengatasi risiko AI akan meningkatkan kepercayaan publik dan regulatory terhadap kendaraan otonom, mempercepat adopsi teknologi ini.

- Kepatuhan Regulasi: Kerangka kerja ini menyediakan peta jalan untuk mematuhi standar keselamatan dan keamanan yang berkembang, termasuk yang secara khusus membahas AI, sehingga mempermudah proses sertifikasi dan persetujuan.

- Pengembangan yang Efisien: Dengan memahami keterbatasan DNN sejak awal dalam siklus pengembangan, tim dapat mengalokasikan sumber daya secara lebih efektif untuk mitigasi risiko, menghindari pengerjaan ulang yang mahal di kemudian hari. ARSA Technology, dengan tim yang berpengalaman sejak 2018 dalam rekayasa AI dan IoT, menerapkan metodologi yang ketat untuk memastikan keandalan dan keamanan dalam semua proyek.

Penelitian ini menggarisbawahi perlunya pendekatan yang disengaja dan terpadu untuk mengevaluasi dan mengatasi kelemahan mendasar dalam teknologi AI yang menjadi tulang punggung sistem yang kritis seperti kendaraan otonom. Dengan menyelaraskan analisis bahaya dan ancaman yang berpusat pada DNN dengan standar industri, pengembang dapat bergerak menuju masa depan di mana kendaraan otonom tidak hanya canggih tetapi juga secara inheren aman dan terjamin.

Jika organisasi Anda tertarik untuk membangun solusi AI dan IoT yang andal dan aman yang tahan terhadap tantangan dunia nyata, jelajahi berbagai solusi ARSA dan hubungi tim ARSA untuk konsultasi gratis.