Prune-Quantize-Distill: Panduan Terstruktur untuk Kompresi Jaringan Saraf Efisien

Pelajari pipeline Prune-Quantize-Distill untuk kompresi jaringan saraf yang efisien. Optimalkan model AI untuk perangkat edge dengan akurasi, ukuran, dan latensi terbaik.

Jaringan saraf tiruan (DNN) telah merevolusi berbagai bidang, mulai dari penglihatan komputer hingga pemrosesan bahasa alami. Namun, model-model modern sering kali berukuran sangat besar dan membutuhkan sumber daya komputasi yang tinggi, menjadikannya tantangan untuk diterapkan di platform dengan keterbatasan sumber daya. Perangkat seperti ponsel, sistem tertanam, dan akselerator edge memiliki batasan memori, daya, dan latensi inferensi yang ketat. Dalam konteks ini, kompresi model AI menjadi sangat penting.

Pendekatan umum untuk membuat model lebih kecil sering kali mengorbankan akurasi secara signifikan. Penelitian terbaru menunjukkan bahwa strategi hibrida yang menggabungkan beberapa teknik kompresi lebih unggul daripada menggunakan satu teknik saja. Artikel ini membahas sebuah metodologi yang disebut Prune-Quantize-Distill (PQD), sebuah pipeline terstruktur yang secara efektif mengoptimalkan model AI untuk kinerja tinggi di lingkungan yang terbatas, fokus pada metrik kinerja dunia nyata seperti latensi.

Optimalisasi AI di Lingkungan Terbatas: Mengapa Ukuran dan Kecepatan Itu Penting

Implementasi AI modern sering kali dihadapkan pada pilihan sulit: mengorbankan akurasi demi efisiensi di bawah batasan CPU dan memori yang ketat. Ironisnya, metrik kompresi umum seperti jumlah parameter atau FLOPs (operasi floating point) tidak selalu menjadi prediktor yang andal untuk "waktu inferensi sebenarnya" (wall-clock inference time). Misalnya, pengurangan parameter secara sporadis (unstructured sparsity) dapat mengurangi penyimpanan model, tetapi terkadang tidak mempercepat bahkan sedikit memperlambat eksekusi CPU standar. Hal ini disebabkan oleh akses memori yang tidak teratur dan overhead kernel yang jarang (sparse-kernel overhead).

Kesenjangan antara kompresi dan akselerasi inilah yang mendorong para peneliti untuk mencari solusi yang lebih praktis. Di sinilah pentingnya PQD. Pendekatan ini secara eksplisit menargetkan latensi terukur, memastikan bahwa upaya kompresi benar-benar menghasilkan manfaat kecepatan di dunia nyata. Ini sangat krusial untuk aplikasi AI di perangkat edge, di mana respons real-time adalah kunci. Sebagai penyedia solusi AI & IoT, ARSA Technology memahami bahwa implementasi praktis membutuhkan model yang tidak hanya akurat tetapi juga efisien dalam penggunaan sumber daya dan sangat cepat dalam proses inferensinya.

Mengenal Tiga Pilar Kompresi: Pruning, Kuantisasi, dan Distilasi Pengetahuan

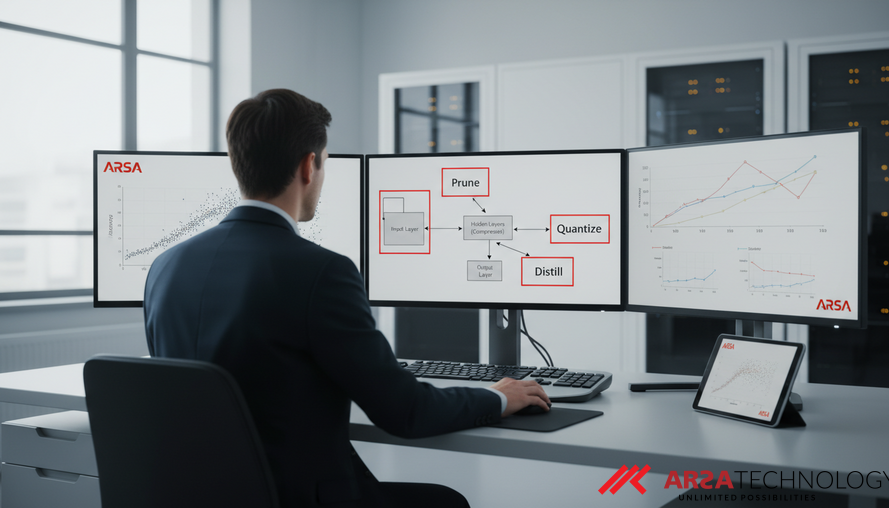

Pipeline PQD menggabungkan tiga teknik yang sudah dikenal luas: pruning tak terstruktur, quantization-aware training (QAT) INT8, dan knowledge distillation (KD). Mari kita jelajahi masing-masing komponen:

- Pruning (Pemangkasan): Bayangkan jaringan saraf sebagai pohon yang lebat. Pruning adalah proses memangkas cabang-cabang (parameter atau koneksi) yang tidak terlalu berkontribusi pada hasil akhir. Tujuannya adalah mengurangi kapasitas efektif model dengan kehilangan akurasi yang minimal. Dalam konteks PQD, pemangkasan ini dilakukan secara global dan tak terstruktur, artinya koneksi yang tidak penting dipangkas di seluruh jaringan tanpa mengikuti pola tertentu. Manfaat utamanya di sini bukan hanya kecepatan secara langsung, tetapi sebagai "pre-kondisioner" yang mengurangi jumlah bobot aktif, membuat langkah optimasi berikutnya lebih stabil.

- INT8 Quantization-Aware Training (QAT) (Kuantisasi Sadar-Pelatihan): Ini adalah teknik yang paling dominan dalam memberikan manfaat runtime (waktu eksekusi). Kuantisasi melibatkan pengurangan presisi angka yang digunakan dalam model AI, seperti bobot dan aktivasi, dari format floating-point presisi tinggi (misalnya, 32-bit) menjadi integer presisi rendah (misalnya, 8-bit). Bayangkan melakukan perhitungan dengan angka bulat sederhana daripada angka desimal panjang. Ini mengurangi ukuran penyimpanan model dan memungkinkan inferensi yang lebih cepat pada backend integer standar, seperti INT8 yang banyak digunakan di hardware modern. "Sadar-pelatihan" berarti model dilatih sejak awal dengan batasan presisi rendah ini, sehingga belajar untuk tetap akurat meskipun menggunakan representasi angka yang lebih sederhana.

- Knowledge Distillation (KD) (Distilasi Pengetahuan): Setelah model dikompresi melalui pruning dan kuantisasi, mungkin ada sedikit penurunan akurasi. Knowledge Distillation adalah teknik untuk "memulihkan" akurasi ini. Caranya adalah dengan melatih model yang lebih kecil dan sudah dikompresi (disebut "siswa") untuk meniru perilaku model yang lebih besar dan lebih kuat (disebut "guru"). Model siswa belajar dari output yang "dilunakkan" dari guru, sehingga bisa mencapai akurasi yang mirip tanpa mengubah ukuran atau latensi model yang sudah dikompresi. KD diterapkan sebagai langkah terakhir untuk memaksimalkan akurasi dalam batasan model INT8 yang sudah jarang.

Pipelines Terurut: Kunci Efisiensi AI yang Sesungguhnya

Inovasi utama dalam penelitian ini adalah proposal urutan yang spesifik untuk ketiga teknik kompresi ini: pruning → QAT INT8 → KD. Urutan ini tidak sembarangan; ini adalah bagian integral dari metodologi dan secara khusus menargetkan bentuk penerapan yang konsisten: model INT8 yang sudah dipangkas (sparse INT8).

Para peneliti menemukan bahwa masing-masing tahapan memainkan peran komplementer:

- Pruning menyiapkan model dengan mengurangi kapasitas dan membuat optimasi presisi rendah berikutnya menjadi lebih kuat dan stabil. Tanpa pruning awal, kuantisasi model yang padat bisa menjadi lebih rapuh.

- QAT INT8 memberikan sebagian besar peningkatan kecepatan yang terukur, memungkinkan model berjalan jauh lebih cepat pada CPU standar.

- KD kemudian berfungsi untuk mengembalikan akurasi yang mungkin sedikit hilang selama proses kompresi, memastikan model tetap kompetitif tanpa mengubah format deployment-nya.

Melalui studi ablasi terkontrol dengan alokasi epoch pelatihan yang tetap, penelitian ini secara empiris mengkonfirmasi bahwa urutan tahapan sangat berpengaruh. Urutan yang diusulkan (Prune-Quantize-Distill) secara umum memberikan kinerja terbaik di antara permutasi yang diuji. Dengan mengadopsi pipeline terurut ini, model mencapai latensi CPU 0,99–1,42 ms yang sangat rendah, dengan akurasi kompetitif dan ukuran model yang ringkas pada berbagai arsitektur dan dataset (ResNet-18 di CIFAR-10, WRN-28-10 di CIFAR-100, dan VGG-16-BN di CIFAR-10).

Ini menunjukkan bahwa memilih urutan yang tepat sangat penting untuk mencapai batas akurasi-ukuran-latensi yang optimal. Hasilnya memberikan pedoman sederhana namun kuat untuk implementasi di edge: selalu evaluasi pilihan kompresi dalam ruang akurasi-ukuran-latensi secara bersamaan, menggunakan waktu eksekusi yang terukur, bukan hanya metrik proxy.

Penerapan Nyata di Industri dengan ARSA Technology

Pendekatan Prune-Quantize-Distill ini memiliki implikasi besar untuk implementasi AI di dunia nyata, terutama bagi perusahaan yang beroperasi di lingkungan dengan sumber daya terbatas dan membutuhkan kinerja real-time. Dengan kemampuan untuk mengoptimalkan model AI agar lebih ringkas, cepat, dan akurat, teknologi ini dapat diterapkan di berbagai sektor yang menjadi fokus ARSA Technology.

Contohnya, dalam solusi AI Video Analytics, model yang dikompresi secara efisien dapat digunakan pada perangkat AI Box Series yang diimplementasikan di lokasi. Ini memungkinkan deteksi objek, pengenalan perilaku, dan pemantauan keamanan secara real-time di pabrik, lokasi konstruksi, atau fasilitas publik tanpa memerlukan konektivitas cloud yang konstan atau bandwidth tinggi. Untuk solusi AI BOX - Traffic Monitor, kompresi ini berarti analisis kepadatan lalu lintas dan klasifikasi kendaraan dapat dilakukan dengan cepat di perangkat edge, memberikan data yang akurat untuk manajemen lalu lintas kota cerdas.

Selain itu, di sektor kesehatan, kios kesehatan mandiri seperti Self-Check Health Kiosk ARSA dapat memanfaatkan model AI yang dioptimalkan untuk melakukan tes Romberg berbasis AI dan pengukuran tanda vital lainnya dengan cepat dan akurat, mengurangi beban kerja staf medis dan mempercepat alur pasien. Efisiensi komputasi dari model yang dikompresi ini memastikan bahwa perangkat dapat beroperasi secara otonom dengan konsumsi daya minimal dan respons instan, menjadikan AI lebih praktis dan menguntungkan.

Kesimpulan: Panduan Praktis untuk Implementasi AI di Edge

Penelitian "Prune-Quantize-Distill: An Ordered Pipeline for Efficient Neural Network Compression" (Sumber: arxiv.org/abs/2604.04988) menegaskan pentingnya pendekatan sistematis dan terurut dalam kompresi jaringan saraf. Dengan memadukan pruning, kuantisasi INT8, dan distilasi pengetahuan dalam urutan yang tepat, dimungkinkan untuk mencapai keseimbangan yang optimal antara akurasi, ukuran model, dan latensi inferensi.

Ini adalah kabar baik bagi para praktisi dan perusahaan yang ingin menerapkan AI yang kuat di lingkungan dengan batasan sumber daya, seperti perangkat edge atau sistem tertanam. Kuncinya adalah tidak hanya mengurangi ukuran model, tetapi juga memastikan bahwa pengurangan tersebut benar-benar menghasilkan akselerasi yang terukur di hardware target. Pendekatan ini memberikan cetak biru yang jelas untuk membangun sistem AI yang efisien, andal, dan siap produksi, membuka jalan bagi inovasi di berbagai industri.

Untuk menjelajahi lebih lanjut bagaimana solusi AI yang dioptimalkan ini dapat diterapkan pada kebutuhan spesifik perusahaan Anda, jangan ragu untuk menghubungi tim ARSA untuk konsultasi gratis.